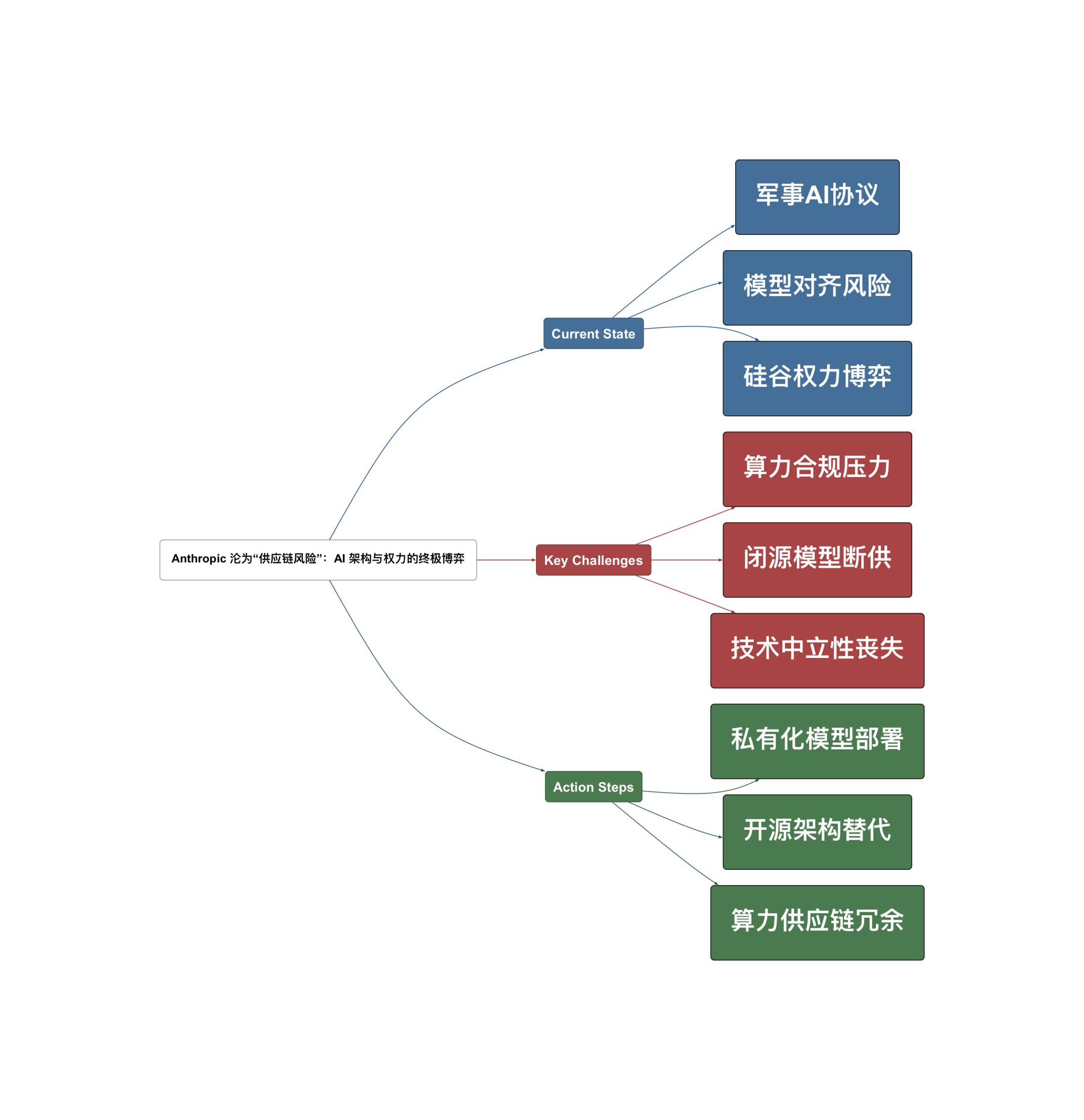

硅谷“宫斗”升级:Anthropic 为何成了五角大楼的“风险”?

Anthropic 被五角大楼正式列入“供应链风险”名单。这不只是两家公司的口水仗,更是 AI 技术架构与国家机器 冲突的里程碑事件。Dario Amodei 甚至在内部备忘录中直言,OpenAI 在军事协议上的说辞是“彻头彻尾的谎言”。

🤔 为什么这件事值得所有技术从业者关注?

因为这暴露了一个残酷的技术现实:当你的模型架构试图在“对齐(Alignment)”和“军事效率”之间寻找平衡时,政府可能会直接绕过你的代码,直接动用供应链武器。

现状:一场“安全性”的技术罗生门

事件起因是国防部(DoD)的一份合同。Anthropic 坚持要在合同中加入硬性的安全红线,而 OpenAI 声称他们在同样的条件下签了约。Dario 的愤怒点在于:如果 DoD 拒绝了 Anthropic 的条件,却接受了 OpenAI,那么 OpenAI 所谓的“安全条款”在 技术执行层面 很可能是空洞且不可强制执行的。

HN 社区里有个高赞评论一针见血:“Sam Altman 哪怕被空投到食人族岛上,五年后他也能当上国王。”

这反映出一种普遍的担忧:OpenAI 正在利用政治斡旋能力,掩盖其在模型安全边界上的技术退让。相比之下,Anthropic 更像是一个固执的工程师,试图用代码和协议锁死 LLM 的军事用途,结果却撞上了铁板。

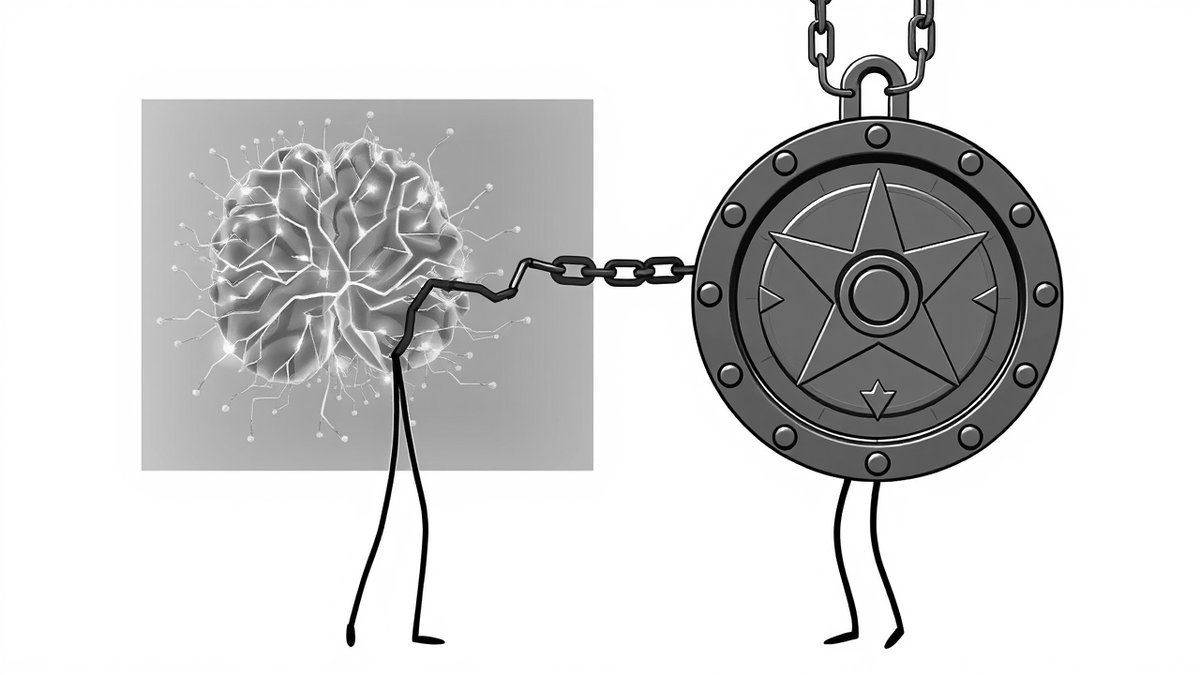

矛盾:当“供应链风险”成为技术锁喉工具

五角大楼的反击极具杀伤力。一旦被列入“供应链风险”,意味着:

– 算力脱钩:Anthropic 可能无法通过受监管的云服务商获取大规模 H100 集群。

– 硬件受限:由于模型权重出口已被视为类 ICBM(洲际导弹)技术,Anthropic 甚至无法轻易搬迁到其他司法管辖区。

– 生态放逐:S&P 500 企业中任何涉及政府业务的供应商,都必须在技术栈中剔除 Claude。

社区反应非常激烈。支持者认为 Anthropic 是在为美国守住底线;但反对者则指出,Anthropic 既然已经接入了 Palantir 这种监控巨头,现在的道德优越感显得有些虚伪。这引出了一个深层的架构问题:LLM 真的适合做大规模监控吗?

社区里有开发者质疑:RAG(检索增强生成)虽然能处理海量数据,但 LLM 的幻觉本质决定了它在自动锁定目标时极具风险。所谓的“安全剧场”,其实掩盖了技术上根本无法百分之百受控的事实。

出路:技术主权的重构

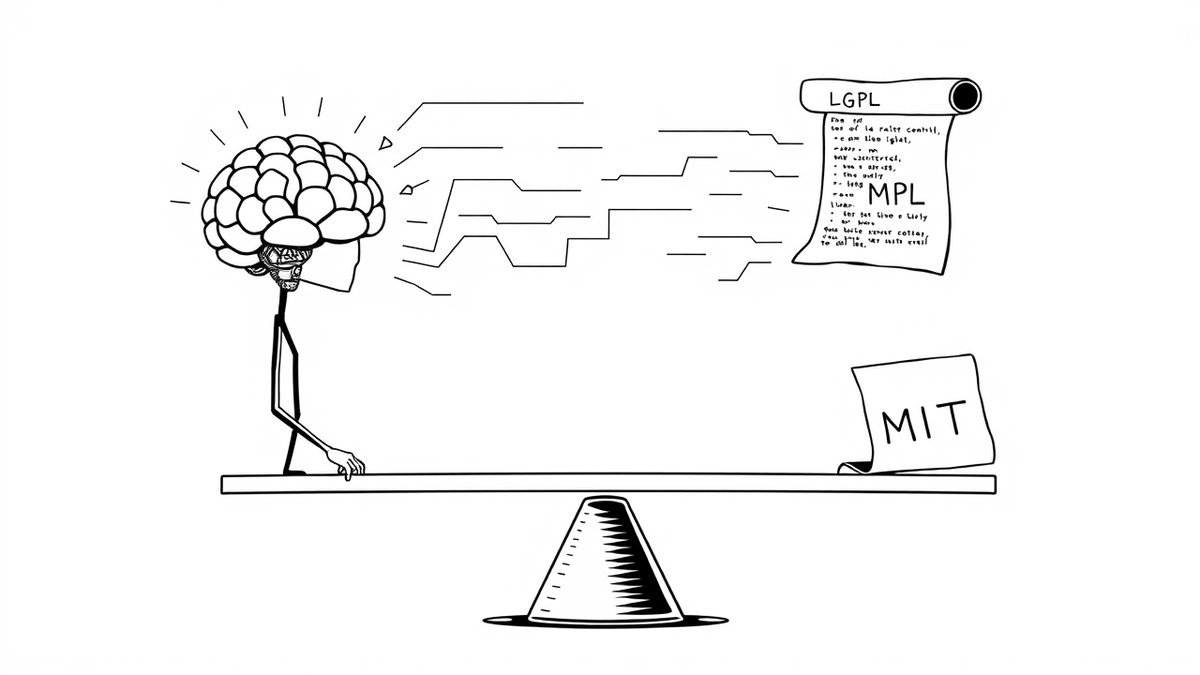

这件事给所有架构师敲响了警钟。过度依赖闭源、中心化的 AI 供应商,本质上是把系统的 生存权 交托给了政客的笔尖。

- 本地化部署(On-prem):如果你不希望某天因为政策变动导致模型 API 被切断,私有化部署开源权重(如 Llama 3 或 DeepSeek)将从“备选项”变成“必选项”。

- 算力多元化:过度依赖单一供应商(如 NVIDIA + Azure/AWS)会导致极高的政治溢价。

- 架构透明化:我们需要更清晰的“安全审计”标准,而不是像现在这样,由 CEO 们在闭门会议里决定模型能做什么。

说到底,AI 的发展已经告别了纯粹的代码竞争,进入了 “强制对齐(Coerced Alignment)” 的时代。在这种环境下,技术独立性可能比模型参数更值钱。

所以回到最初的问题:你会因为政治风险而放弃使用目前技术领先的 Claude 吗?评论区聊聊。

💡 核心洞察: Anthropic 的遭遇预示着 AI 竞争已进入政商深度绑定阶段,技术团队必须考虑模型供应的政治冗余。

- Dario Amodei calls OpenAI’s messaging around military deal ‘straight up lies’

- Pentagon formally labels Anthropic supply-chain risk