[Tweet 1/6]

大多数大模型其实是“讨好型人格”:如果你问一个看似专业实则胡编乱造的问题,它们会一本正经地胡说八道。

只有 Claude 敢在关键时刻对你直说:“这东西根本不存在。”

[Tweet 2/6]

根据 Chase AI 介绍的 BS Bench(胡说八道基准测试),GPT-4o 和 Gemini 在面对虚假概念时,只有 50% 的几率会反驳。

“比如询问‘差异化补偿分解’这种编造的法律术语,一半的模型会顺着瞎编,只有 Anthropic 家族的反驳率接近 90%。” —— Chase AI

[Tweet 3/6]

这就是典型的系统性摩擦:多数团队试图将 AI 接入现有工作流,却发现 AI 缺乏“边界意识”。

如果模型无法识别无意义的指令,它就会在合规、审计或技术架构中制造极其隐蔽的漏洞,这种“顺从”在生产环境里是致命的风险。

[Tweet 4/6]

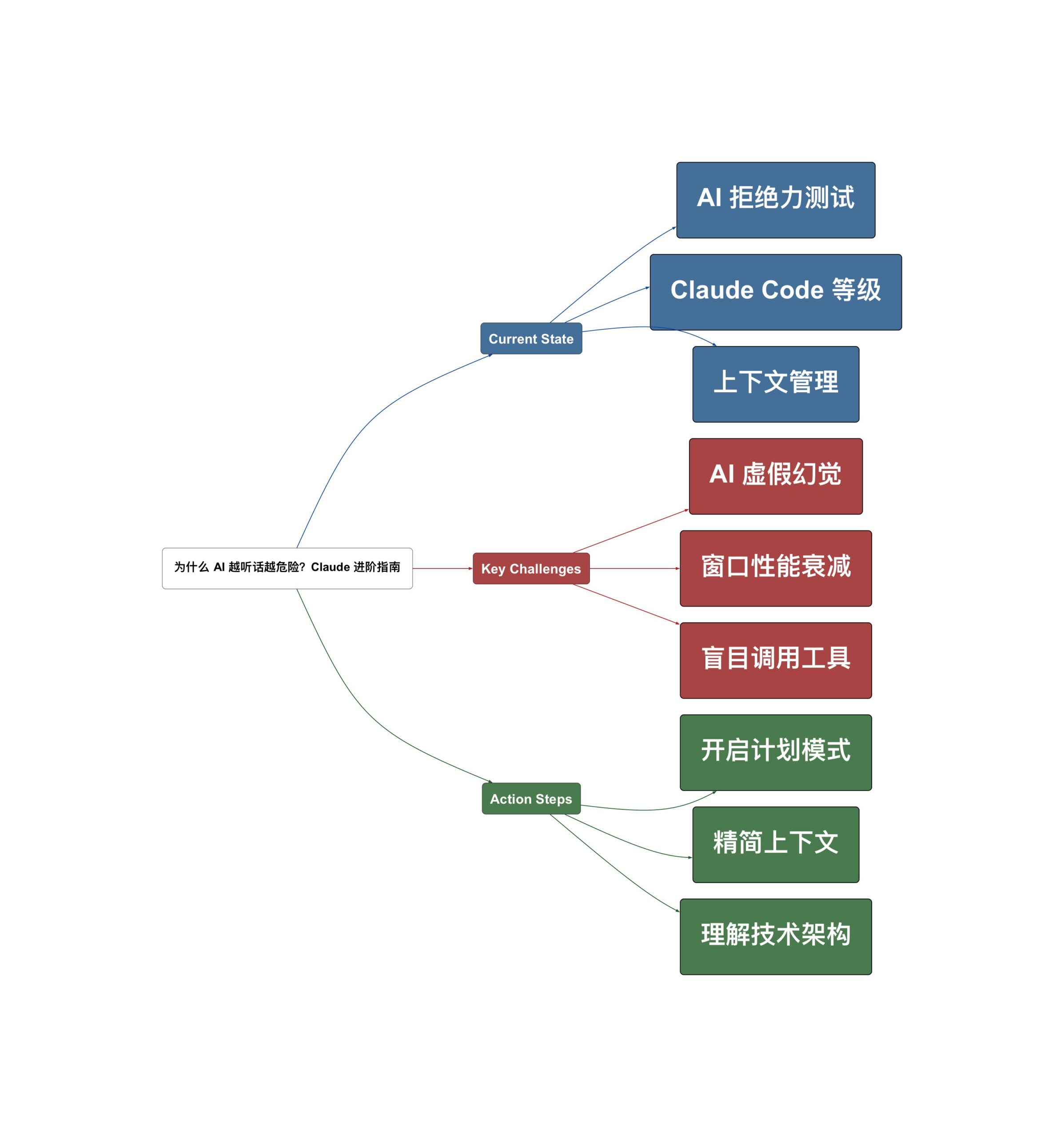

要真正驾驭 AI,必须从“提示词玩家”进化为“上下文工程师”。

Chase AI 提出 Claude Code 的进阶路径:核心分水岭在于你是否在管理它的上下文窗口。当 Token 超过 100k 时,即使是顶级模型,其性能也会出现断崖式下跌。

[INSERT SCREENSHOT HERE: Claude Code 6 Levels diagram showing progression from prompter to workflow master]

[Tweet 5/6]

这种转型不只发生在代码里,在金融决策中也是一样。

AI 可以帮你快速扫描 S&P 500 的财报,但定义风险边界、流动性上限和宏观敞口,仍然是人的架构责任。你需要的不是一个听话的助手,而是一个能推敲你逻辑的伙伴。

[Tweet 6/6]

下周开始优化的三个动作:

1. 强制开启 Plan Mode:让 AI 在执行前先反问你,建立协作闭环。

2. 手术式管理上下文:将 Token 消耗控制在 100k 以内以确保逻辑严密。

3. 掌握底层逻辑:不一定要写代码,但必须理解前端、后端与数据库的协作边界。

💡 核心洞察: 优秀的 AI 不应只会执行指令,更要具备在系统逻辑错误时拒绝执行的架构意识。

Video Sources